LLM On-Page SEO 2026: Der Praxis-Guide für zitierfähige Inhalte

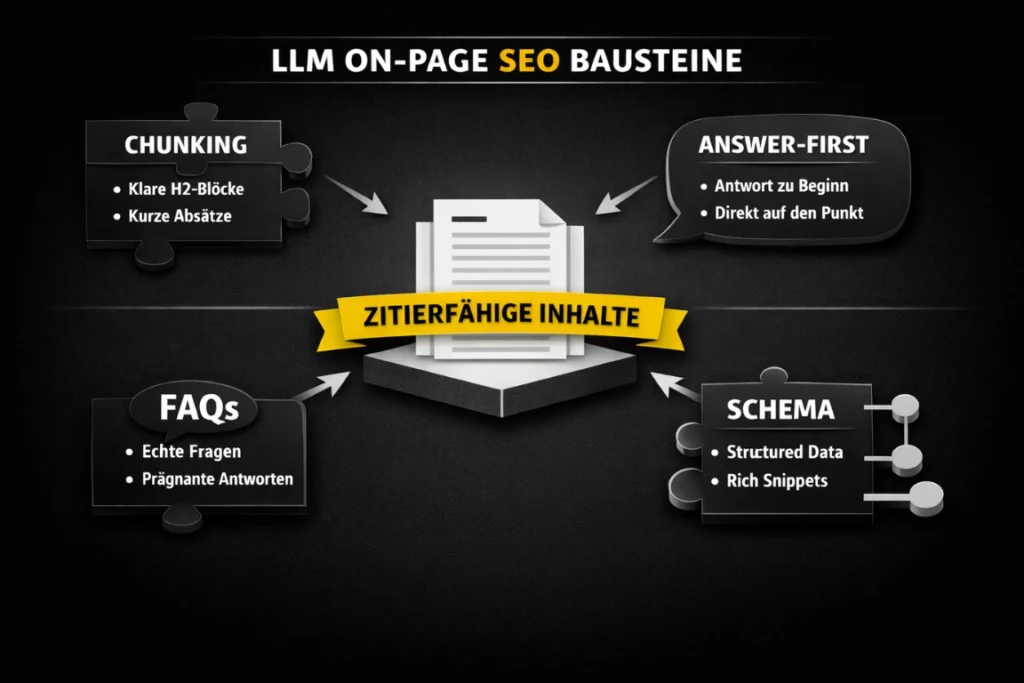

Wenn du 2026 Inhalte veröffentlichst, optimierst du nicht mehr nur für „Rankings“, sondern für Verständlichkeit pro Abschnitt: für Nutzer, für Google – und für AI-Answer-Engines. LLM On-Page SEO beschreibt genau diese Disziplin: Content so aufzubauen, dass Systeme Inhalte schnell erfassen, sauber extrahieren und bei Bedarf zitieren können.

Das ersetzt klassisches On-Page SEO nicht – es schärft es. Google nennt Keywords weiterhin als „basisches Relevanzsignal“ und nutzt zusätzlich aggregierte Interaktionsdaten zur Relevanzbewertung.

Die Konsequenz: Du brauchst Relevanz + Struktur + Nutzersignal-Kompatibilität – nicht „mehr Text“.

Was ist LLM On-Page SEO (2026) – und was ist es nicht?

LLM On-Page SEO ist die Optimierung deiner Seitenstruktur und Formulierungen, damit Inhalte abschnittsweise verstanden und verwertet werden können – ohne dass Kontext fehlt. Es ist kein Trick, um „die KI auszutricksen“, und auch kein Ersatz für echte Substanz.

LLM On-Page SEO maximiert die Wahrscheinlichkeit, dass ein einzelner Abschnitt deiner Seite als beste Antwort auf eine konkrete Frage erkannt wird.

Warum Struktur jetzt ein Sichtbarkeitshebel ist

Google hat öffentlich beschrieben, dass Search spezifische Passagen einer Seite besser verstehen kann, um „Needle-in-a-haystack“-Information zu finden.

Parallel sind AI-Antwortsysteme darauf ausgelegt, Inhalte zu extrahieren und als kompakte Antworten zu präsentieren. Das belohnt Seiten, deren Abschnitte in sich geschlossen sind.

Wenn ein Abschnitt ohne Einleitung und ohne Nachbarsätze verständlich ist, steigt seine Chance, als Antwort-Passage ausgespielt zu werden.

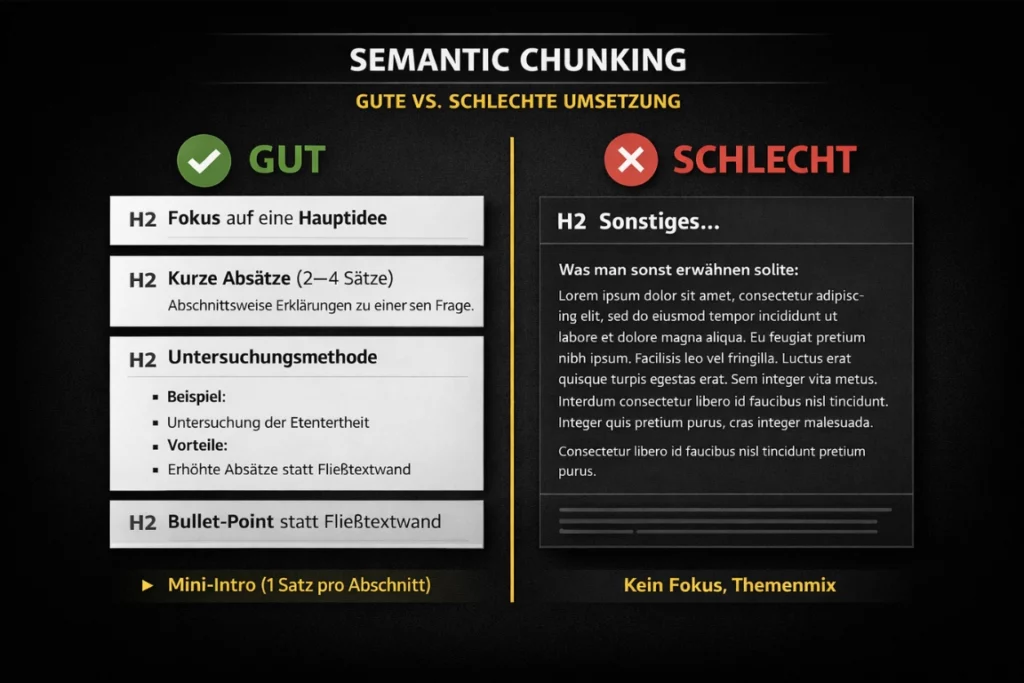

Semantic Chunking: So baust du Abschnitte, die LLMs sauber extrahieren können

Semantic Chunking heißt: Du zerlegst Inhalte in klar abgegrenzte „Mini-Ressourcen“.

Regeln, die fast immer funktionieren:

- Jede Hauptidee bekommt eine eigene H2 (kein Sammelabschnitt „Sonstiges“).

- Kurze Absätze (2–4 Sätze), damit Passagen nicht „verschwimmen“.

- Wo sinnvoll: Bullets, Tabellen, Schrittfolgen statt Fließtextwände.

- Pro Abschnitt ein Mini-Intro (1 Satz), das die Kernaussage ankündigt.

Ein guter H2-Block beantwortet genau eine Frage vollständig – und lässt sich isoliert lesen.

Answer-first Writing: Der schnellste Weg zu zitierfähigen Passagen

Startet ein Abschnitt mit einer indirekten Einleitung, wird er schwerer zu extrahieren. Starte stattdessen konsequent mit der Antwort.

Pattern (1:1 übernehmbar):

- Antwort in 1–2 Sätzen

- Begründung / Kontext

- Beispiele / Umsetzung

- Mini-Zusammenfassung oder Takeaway

Answer-first reduziert die Interpretationsarbeit für Nutzer und Systeme – und erhöht die Nutzbarkeit der Passage.

Überschriften, die wie echte Suchanfragen klingen (Query-Matching)

„Step 1“ hilft niemandem! H2s sollen Suchfragen spiegeln, weil das Matching einfacher wird.

Schlechte H2s: „Grundlagen“, „Schritt 1“, „Weitere Tipps“

Bessere H2s:

- „Wie strukturiere ich Content für LLM-Zusammenfassungen?“

- „Welche FAQs erhöhen die Chance auf AI-Zitate?“

- „Wann lohnt sich FAQ-Schema wirklich?“

Je näher eine Überschrift an realen Queries ist, desto leichter kann ein System genau diesen Abschnitt als Antwort identifizieren.

Quotable Sentences: Der unterschätzte Baustein

LLMs bevorzugen Sätze, die vollständig sind und ohne Kontext Sinn ergeben.

So sehen „quotable“ Sätze aus:

- definierend („X ist …“)

- kausal („X wirkt, weil …“)

- operational („Du erreichst X, indem du …“)

Anti-Pattern: „Das ist wichtig“, „Man sollte“, „Es kommt darauf an“ (ohne harte Kriterien)

Schreibe pro Abschnitt mindestens einen Satz, der als eigenständiges Mini-Zitat funktioniert.

FAQs, die wirklich matchen (und nicht nur Deko sind)

FAQs sind stark, wenn sie echte Fragen abbilden und Antworten kurz sind.

FAQ-Regeln:

- 5–8 Fragen, die aus Intent/Unterfragen kommen (nicht aus Fantasie)

- Antworten: 2–5 Sätze, direkt, ohne Marketing

- Wo möglich: klare Definitionen, Listen, Kriterien

FAQ-Blöcke liefern „fertige Q&A-Einheiten“ – genau das, was Answer-Systeme leicht verwerten können.

Metadaten & CTR: Title/Description so bauen, dass Nutzer klicken

Google generiert laut eigener Aussage Snippets und Title Links automatisiert und kann sie abhängig von Query und Kontext umschreiben.

Meta-Descriptions werden in manchen Fällen als Snippet genutzt, häufig stammen Snippets aber laut Google aus dem Seiteninhalt.

Praktische Umsetzung:

- Title: Keyword/Topic klar, Nutzen klar, kein Clickbait.

- Description: konkretes Nutzenversprechen + Erwartungsmanagement.

- On-Page Snippet-Text: Baue im Artikel selbst kurze definierende Absätze ein, damit Google gute Textstellen ziehen kann.

Wenn deine Seite selbst gute „Snippet-Sätze“ enthält, steigt die Chance, dass Suchsysteme genau diese Passagen übernehmen.

Schema/Structured Data: Wann es hilft – und was es nicht löst

Schema ist primär ein Verständlichkeits- und Darstellungswerkzeug: Es macht Inhalte für Systeme präziser interpretierbar und kann Rich-Result-Eignung unterstützen. Google beschreibt Structured Data als Voraussetzung für Rich Results; eine Structured-Data-Manual-Action betrifft Rich-Result-Eignung und nicht das Web-Ranking.

Wann Schema sinnvoll ist:

- FAQPage, wenn du echte FAQs hast

- HowTo, wenn du echte Schritte hast

- Article, wenn du redaktionellen Content hast

Schema ersetzt keine inhaltliche Klarheit – es verstärkt sie, wenn Struktur und Inhalt bereits sauber sind.

Interne Links, Bilder, Performance: klassische Faktoren mit LLM-Mehrwert

Interne Links

- Verlinke kontextnah zu vertiefenden Inhalten (Definitionen, Tools, Prozesse).

- Anchor: beschreibend, natürlich, themennah.

Bilder

- Dateiname + Alt-Text beschreibend, kein Stuffing.

- Alt-Text hilft nicht nur Accessibility, sondern liefert auch Systemsicht Kontext.

Performance

- Komprimierte Bilder, moderne Formate (WebP/AVIF), keine „Hero-Grafik“, die den Content nach unten drückt.

Alles, was Verständlichkeit erhöht (Links, Alt-Texte, Ladezeit), erhöht indirekt auch Extrahierbarkeit und Nutzbarkeit deiner Inhalte.

QA-Workflow: So operationalisierst du LLM On-Page SEO

Minimaler Prozess pro Beitrag:

- Intent + Unterfragen definieren

- Outline mit query-nahen H2s bauen

- Pro H2: Answer-first + 1 quotable sentence

- FAQ-Block ergänzen

- Meta/Title/Slug setzen

- Passendes Schema hinzufügen

- Interne Links + Bild-Alt-Texte + Performance prüfen

- Monitoring: CTR, Rankings, Engagement

Google betont „helpful, reliable, people-first content“ als Zielrichtung ihrer Systeme.

Key Takeaways

- LLM On-Page SEO ist vor allem Struktur- und Formulierungsdisziplin: Abschnitte müssen eigenständig funktionieren.

- Nutze Semantic Chunking: klare H2s, kurze Absätze, Listen, Tabellen.

- Jeder Abschnitt startet mit Answer-first.

- Schreibe pro Abschnitt mindestens 1 quotable sentence.

- Baue echte FAQs ein (Q&A-Einheiten sind leicht verwertbar).

- Metadaten optimieren CTR; Snippets/Title Links können automatisch umgeschrieben werden.

- Schema verstärkt saubere Struktur und kann Rich-Result-Eignung unterstützen.

FAQ

Was ist der wichtigste Hebel für LLM-Sichtbarkeit on-page?

Klare, eigenständige Abschnitte: query-nahe H2s, Answer-first, kurze Absätze und mindestens ein zitierfähiger Kernsatz pro Abschnitt.

Muss ich für LLMs anders schreiben als für Google?

Du schreibst klarer und modularer. Das hilft Google (Passagenverständnis) und AI-Antwortsystemen gleichermaßen.

Sollte jeder Beitrag ein FAQ-Schema haben?

Nur wenn echte FAQs vorhanden sind. Schema ohne passenden Inhalt ist nutzlos und kann Richtlinienrisiken erhöhen.

Sind Meta-Descriptions wichtig, wenn Google sie oft ersetzt?

Ja, weil Google sie in manchen Fällen nutzt und weil sie dir helfen, den Snippet-Text zu „steuern“. Snippets werden automatisch aus Content und teils Meta-Description generiert.

Wie viele “Chunks” sind ideal?

So viele, wie nötig, damit jede Frage separat beantwortet wird. Zu große Sammelabschnitte reduzieren Extrahierbarkeit.

Fazit

Wenn du 2026 „LLM-fähig“ optimieren willst, denk nicht in „Artikel“, sondern in Antwort-Module: query-nahe Überschriften, Answer-first, quotable Sätze, echte FAQs, saubere Struktur + Schema.